音楽を聴いた「喜び」や「安心」が脳波でわかる?──脳が感じる音楽の“気持ち”を読み解く

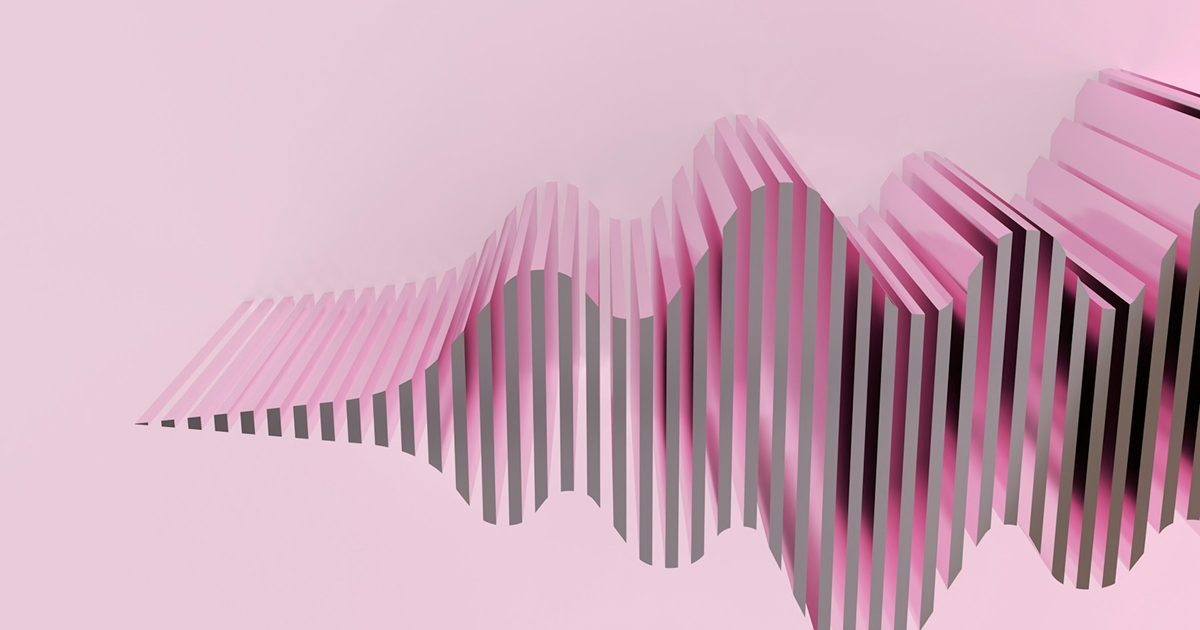

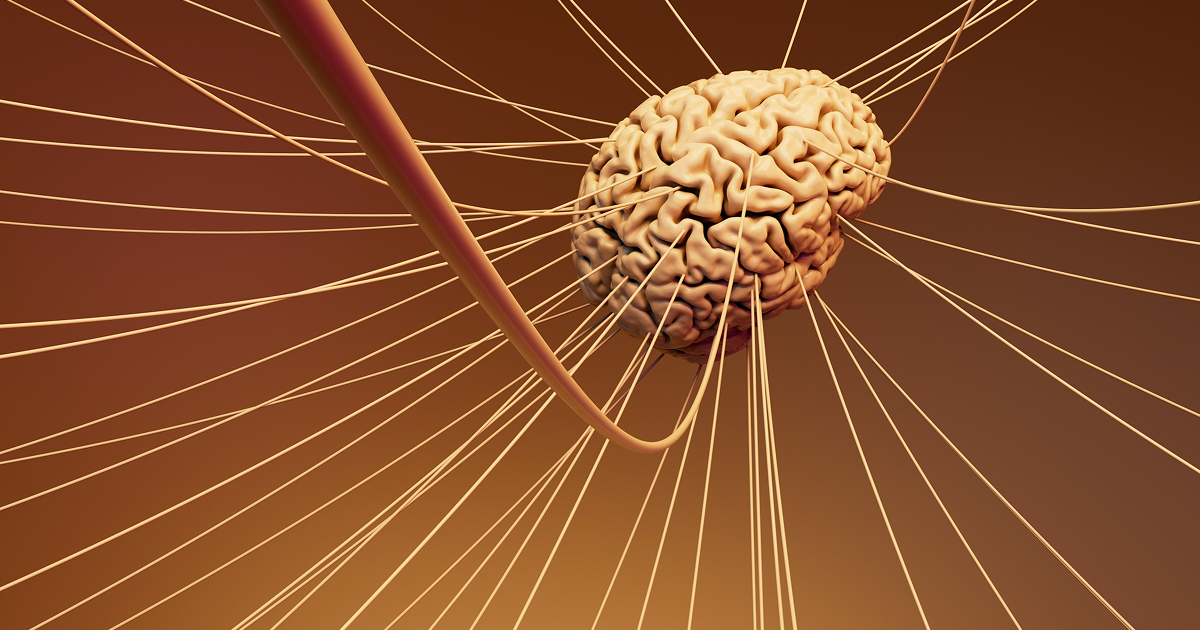

「音楽を聴くと心が踊る!」そんな経験、きっと誰にでもありますよね。でも、どうして音楽がこれほどまでに私たちの感情を揺さぶるのでしょうか? その謎に、脳波(EEG)を使って迫ろうとする最新のブレインテック研究が登場しました。2024年にIEEEで発表された注目の研究では、音楽を聴いているときの脳波から、その人の感情を4つのカテゴリーに分類するというチャレンジが行われています。 今回は、音楽と脳の意外なつながり、そしてこの研究から見えてくる新しい可能性について、わかりやすくご紹介します。 音楽を聴いているとき、脳では何が起きているのか? 今回紹介するのは、2024年にIEEEで発表された最新研究「EEG-Music Emotion Recognition: Challenge Overview」です。この研究では、音楽を聴いているときの脳波(EEG)に注目し、そこから「喜び」「安心」「悲しみ」「怒り」といった感情を推定することにチャレンジしています。 脳波とは、頭の表面から記録できる微弱な電気信号で、私たちの脳が活動している証のようなものです。音楽を聴いているとき、脳はこの信号を通してさまざまな反応を見せてくれます。 また、音楽は人の感情を強く動かす刺激として知られており、実際に「楽しい」「切ない」「緊張する」など、聴いているだけで気持ちが大きく揺れ動くこともあります。こうした感情の動きが、脳波のパターンにも現れるのではないか――そんな仮説のもと、研究チームは脳波から感情を読み取ることに挑戦しました。 このアプローチは、今までの「表情や心拍から感情を推測する」という方法とは一味違います。というのも、脳波は脳内で直接起こっている活動を捉えるため、音楽による微細な感情の変化もより直接的に反映されるからです。もちろん、脳波自体は非常に微弱でノイズも多く、解析は簡単ではありませんが、ディープラーニングをはじめとする最新の機械学習技術によって、そうした複雑なパターンの解明も少しずつ可能になりつつあります。 好きな曲 vs 初めての曲、脳はどう反応する? この研究では、20代〜30代の被験者34人が参加し、音楽を聴いているときの脳波を記録しました。使われた曲は16曲で、半分は被験者が選んだ“お気に入りの曲”、もう半分は他の人が選んだ“初めて聴く曲”です。慣れた音楽と新しい音楽で脳の反応がどう変わるかも調べています。 音楽を聴いた後には、「どんな気持ちになったか?」を、感情マップ(ジュネーブ感情ホイール)を使って自己申告してもらいました。この回答が、AIにとっての感情の正解になります。 つまり、本人がどう感じたかをラベルとして使うことで、「この脳波は安心のとき」「これは怒りのとき」といったデータをAIに学習させることができます。これが「教師あり学習」と呼ばれる方法です。 これを使って解析した結果、脳波は人によって違いはあるものの、特定の感情に共通する傾向があることが確認されました。 感情の読み取りは本当にできるの? この研究の目的は、脳波から「今、どのような感情を感じているのか?」という問いに答えられるようにすることです。しかし、現時点での精度は約30%程度で、4つの感情カテゴリーの中からランダムに選んだ場合の正答率(25%)をやや上回る水準にとどまっています。 出典:S. Calcagno, S. Carnemolla, I. Kavasidis, S. Palazzo, D. Giordano and C. Spampinato, "EEG-Music Emotion Recognition: Challenge Overview," ICASSP 2025 - 2025 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP), Hyderabad, India, 2025, pp. 1-3, doi: 10.1109/ICASSP49660.2025.10888506. とはいえ、これはあくまでもスタート地点です。研究チームはこの結果をもとに、精度をさらに高めるための新たな手法の開発やデータの充実に取り組んでいます。ブレインテックの分野は日々進化しており、次のステップでは、より精度の高い成果が期待されます。 あなたの脳に合わせた音楽療法の実現可能性 注目すべきは、この技術が単なる実験に留まらず、実用面での応用が期待されている点です。たとえば、音楽療法の分野では、患者が音楽を聴いているときの脳波をリアルタイムで解析し、最適な治療法を提案することが可能になるかもしれません。 うつ病や不安障害の治療現場では、音楽を使ったセラピーの効果を脳波で見える化することで、患者ごとに合った曲の選定や、セラピー中の状態把握に役立てられる可能性があります。 また、介護や認知症ケアの現場でも、音楽による感情反応を脳波で捉えることで、患者の状態を見守りながら心を落ち着かせる音楽環境をつくるといった応用も期待されます。将来的には、ウェアラブル脳波計と連動した音楽プレーヤーが登場し、そのときの精神状態に合わせてリラックスできる音楽を自動選曲してくれるようなシステムも考えられます。 🧠 編集後記|BrainTech Magazineより 音楽は私たちの心を大きく揺さぶります。その感動の裏側には、まだ未知の脳波パターンが隠れているかもしれません。IEEEで発表された今回の研究は、そんな“脳が感じる音楽”を読み解こうとする第一歩です。 精度はまだ発展途上ですが、ブレインテックの進化により、音楽療法やメンタルヘルスの分野での応用も現実味を帯びてきています。 この記事が、脳と音楽のつながりに興味を持つきっかけになれば嬉しいです。今後もブレインテックの面白い話題をお届けしていきますので、お楽しみに! 📝本記事で紹介した研究論文 Calcagno, S., Carnemolla, S., Kavasidis, I., Palazzo, S., Giordano, D., & Spampinato, C. (2024). EEG-Music Emotion Recognition: Challenge Overview. 2024 IEEE International Conference on Acoustics, Speech and Signal Processing (ICASSP).IEEE. https://ieeexplore.ieee.org/document/10888506